Editoria e intelligenza artificiale: come cambierà il futuro

L’intelligenza artificiale sta rapidamente trasformando il modo in cui gli editori producono, distribuiscono e pubblicano le notizie. Grazie alle sue capacità di elaborazione del linguaggio naturale, di analisi dei dati e di apprendimento automatico, l’intelligenza può aiutare i giornalisti a fare il loro lavoro più velocemente e con maggiore precisione. Ma cosa significa questo per il futuro dell’editoria? Che impatto avrà l’intelligenza artificiale sulla produzione di contenuti? Ecco un’analisi degli effetti dell’IA sull’editoria.

Intelligenza artificiale e content marketing

L’intelligenza artificiale può essere utilizzata per creare contenuti come notizie, reportage e recensioni. Ci sono già alcuni siti di notizie che usano l’IA per generare in modo automatico notizie sportive e finanziarie. Tuttavia, ci sono alcune preoccupazioni riguardo alla qualità di questi contenuti e al fatto che possano essere privi di una componente umana. In ogni caso, l’AI potrebbe essere un aiuto prezioso per i giornalisti e per gli scrittori in generale che avrebbero a disposizione un mezzo fondamentale per effettuare ricerche e analizzare dati provenienti dal web.

Adesso, per esempio, per fare una ricerca di mercato ci potrebbero volere giorni se non settimane. Con Chat GPT-3, lo strumento creato da OpenAI, i tempi diminuiscono notevolmente. Si tratta di un chatbot che risponde in maniera autonoma e “simula” le risposte umane. Questo chatbot conversazionale risponde alle domande ed è in costante autoapprendimento, esattamente come gli esserei umani. L’AI può aiutare gli editori a personalizzare le notizie per i lettori, utilizzando dati come la posizione geografica, l’età e i gusti personali. Questo porterà a un maggiore coinvolgimento dei lettori e a una maggiore fidelizzazione.

Scrivere un libro con l’AI

Dal punto di vista tecnico, è possibile utilizzare un chatbot basato su GPT (Generative Pre-trained Transformer) per scrivere un libro. Ci sono però alcune considerazioni importanti da tenere a mente. In primo luogo, è importante notare che GPT e altri modelli di intelligenza artificiale basati sull’elaborazione del linguaggio naturale sono ancora lontani dall’essere in grado di scrivere un libro completo e coerente da soli. Anche se GPT è estremamente abile nella generazione di testo, spesso manca di una visione globale del contesto e della coerenza. Di conseguenza può produrre output incoerenti e privi di senso. Inoltre, anche se il chatbot riuscisse a generare un testo completo e coerente, non ci sarebbe garanzie sul fatto che il contenuto risponda alle esigenze di mercato.

La scrittura di un libro richiede non solo la capacità di scrivere, ma anche una conoscenza approfondita del mercato editoriale, delle preferenze dei lettori e della struttura del genere letterario specifico. Infine ci sono anche questioni etiche da considerare quando si utilizzano modelli di intelligenza artificiale per la scrittura. Ad esempio, se un chatbot utilizza testi generati da GPT, è necessario garantire che tali testi siano stati adeguatamente etichettati. Inoltre non devono avere al proprio interno contenuti offensivi o discriminatori. In sostanza utilizzare un chatbot basato su GPT per scrivere un libro potrebbe essere tecnicamente possibile, ma richiederebbe una supervisione umana costante e una conoscenza approfondita del mercato editoriale e delle esigenze del pubblico.

Intelligenza artificiale e verifica delle fonti

La base di qualsiasi contenuto è la verifica delle fonti. Un atto che il nostro cervello fa costantemente. Chat GPT-3 e gli altri modelli di intelligenza artificiale non sono in grado di verificare le fonti in modo autonomo. Questo perché si fondano sull’elaborazione del linguaggio naturale che si basa sull’analisi di grandi quantità di testo esistente per generare il proprio output. Sebbene l’intelligenza artificiale sia in grado di elaborare e analizzare grandi quantità di testo e di imparare dai dati disponibili, non ha la capacità di distinguere tra fonti affidabili e non affidabili o di valutare la qualità delle informazioni che gli vengono fornite.

Di conseguenza, è importante ricordare che quando si utilizza un chatbot basato su GPT per ottenere informazioni, è necessario verificare la fonte e valutare la qualità delle informazioni fornite prima di prenderle per vere. Inoltre, poiché GPT si basa sulla capacità di generare testo in base alle informazioni esistenti è possibile che possa riprodurre informazioni imprecise o errate.

(fonte immagine: Yandex.com)

Newsletter

Resta sempre aggiornato sulle novità in uscita e sulle prossime iniziative

ISCRIVITI ALLA NEWSLETTER

15/05/2025 - 19/05/2025

Fiera Didacta Italia, è il più importante appuntamento fieristico sull’innovazione del mondo della scuola.

15/04/2025 ore 18:00 - 19:30

Anicia Formazione, ente...

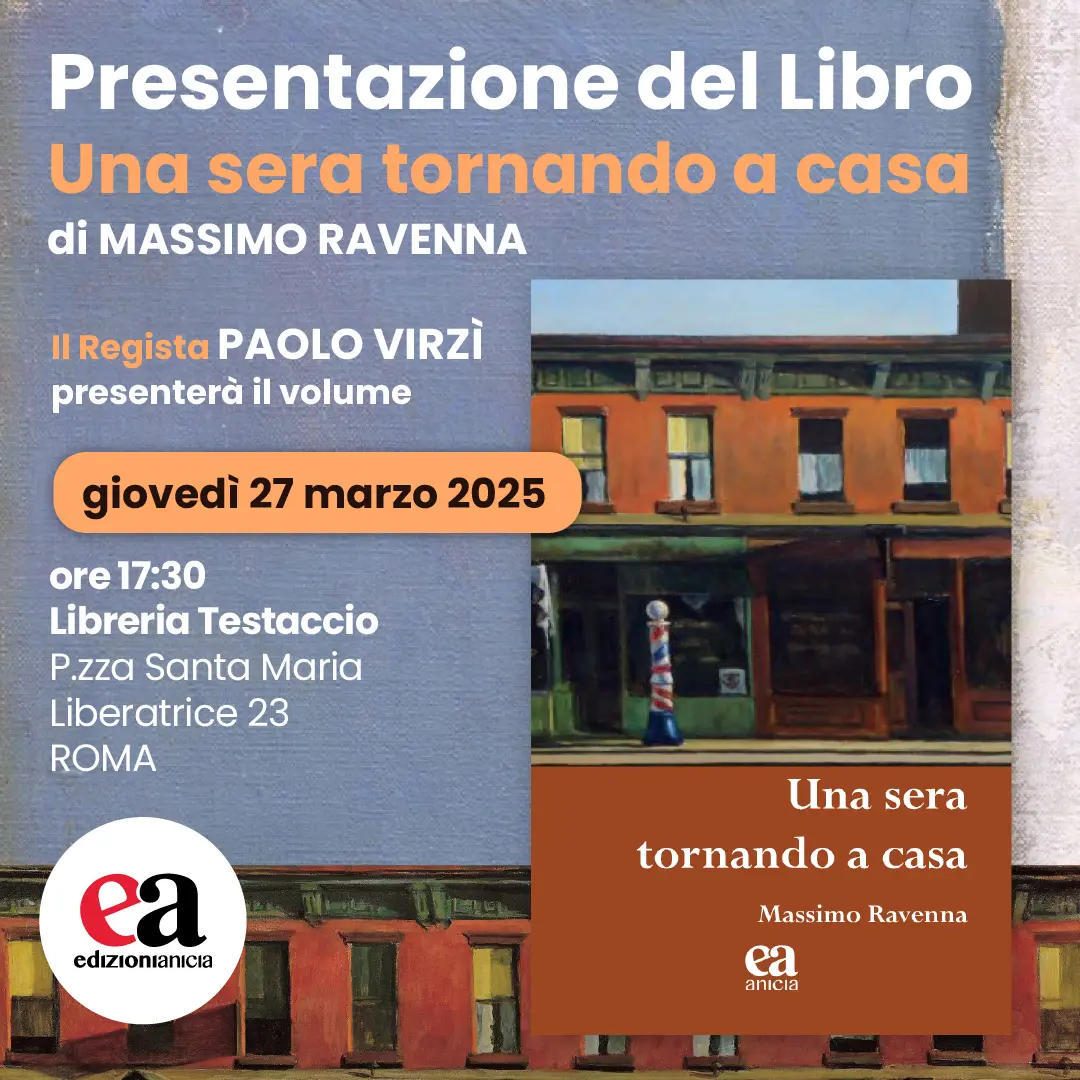

27/03/2025 ore 17:30 - 19:30

Presentazione del libro...